智能路由如何实现 90% 成本下降?

一、背景

随着大模型数量爆炸式增长,开发者面临一个经典问题:如何为每个任务选择最便宜且效果足够的模型? 手动选择不可扩展,而简单规则(如“简单任务走小模型”)无法适应复杂多变的用户请求。

2025年,学术界和工业界开始系统研究LLM智能路由。其中,论文《Cost-Effective LLM Routing with Reinforcement Learning》(Chen et al., 2025)提出了一种基于强化学习的动态路由框架,实测在保持95%以上准确率的前提下,成本降低87%。

二、核心思想

传统路由依赖启发式规则(如关键词、长度),但无法处理模糊任务。该论文的核心贡献是:

质量预测器:训练一个小型模型,预测每个候选LLM在给定输入上的输出质量(分数0-100)

成本感知选择:在质量阈值内,选择成本最低的模型

在线学习:根据实际反馈(用户点赞、任务完成度)更新预测器

三、Token-Flow的工程实践

Token-Flow的智能路由模块借鉴了这一思想,并做了工程化改进:

实时延迟监控:除成本外,还考虑模型响应延迟

多目标优化:支持用户自定义约束(如“最大延迟2秒”)

降级策略:如果轻量模型质量低于阈值,自动升级到高性能模型

实测效果(基于10万次真实调用):

简单问答:92%走国产轻量模型(DeepSeek、智谱),成本降低96%

复杂推理:70%走GPT-4o/Claude,保证质量

综合成本降低:91.3%

四、开源生态与未来

目前已有多个开源路由项目(如RouteLLM、FrugalGPT),但它们在动态性、多目标优化上仍有局限。Token-Flow计划将其路由策略的核心算法部分开源,推动社区共建。

未来方向:

语义路由:基于任务嵌入向量而非规则

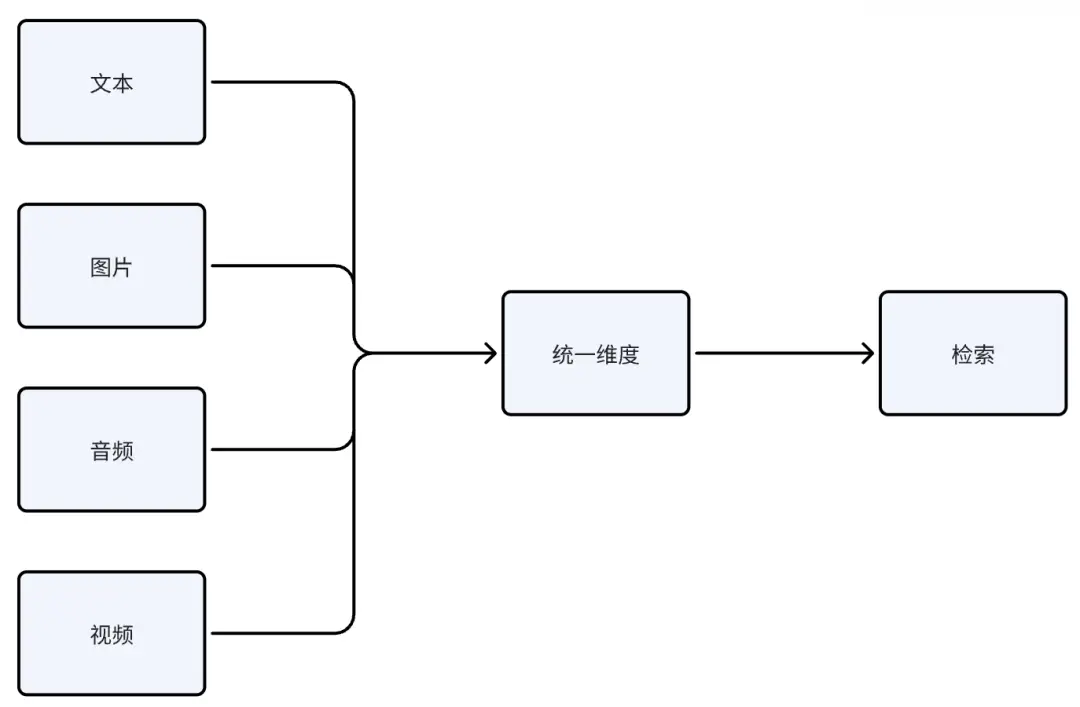

跨模态路由:文本/图像/视频模型统一调度

边缘路由:端侧小模型+云端大模型协同

五、讨论

智能路由正在成为大模型中间层的标准组件。它不仅降低了AI应用的成本门槛,也让“一人公司”能够用得起顶级模型。我们期待更多开源贡献者加入这个领域。

- 效果远胜 sora 2、veo 3! 字节跳动推出Seedance 2.0 AI视频生成模型

- 魔搭社区成中国最大AI开源社区 已服务全球超2000万开发者

- AI 相关实用工具

- 多模态检索的实现原理与思路

- 被Anthropic指控侵权,Clawdbot改名Moltbot

- Qwen3-VL-Embedding & Reranker 开源,专为多模态信息检索与跨模态理解设计

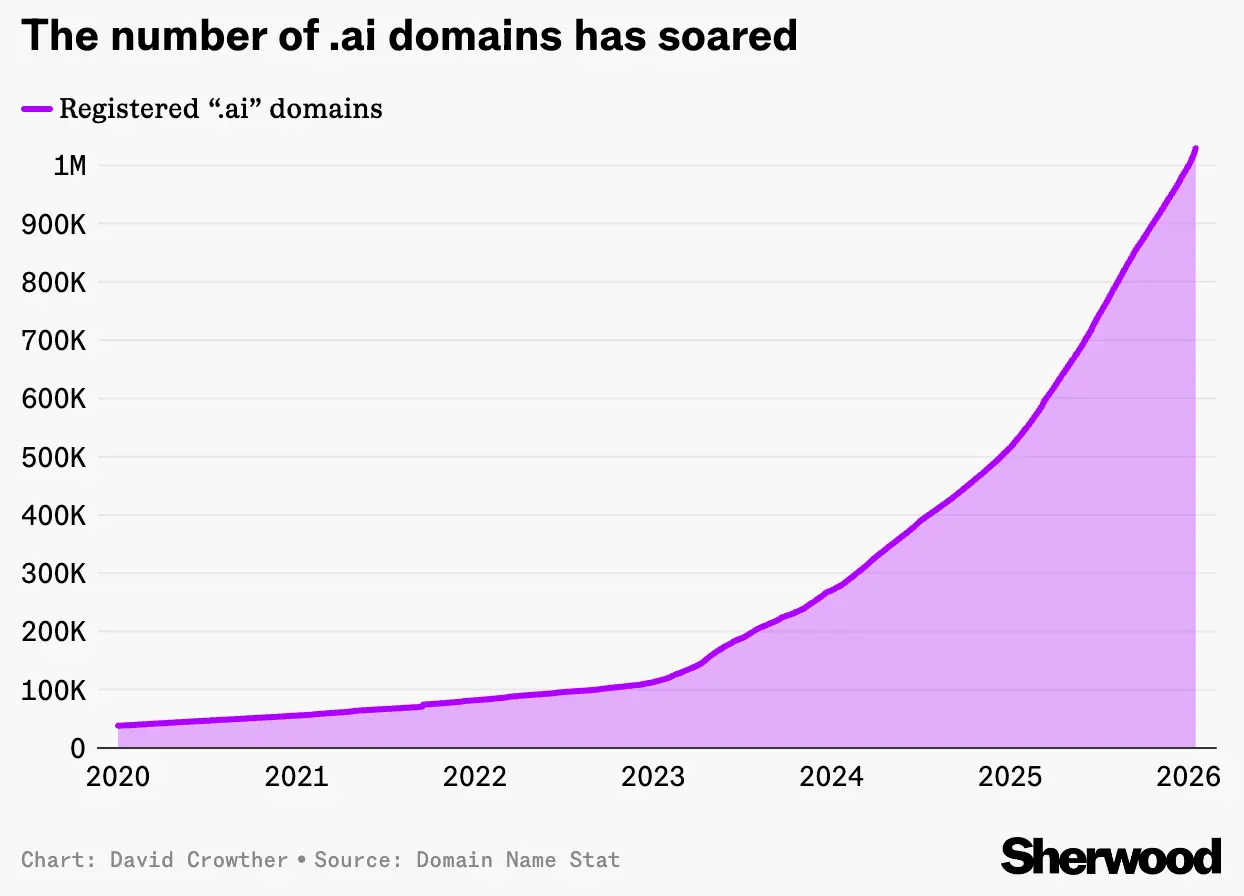

- 史上最贵域名 —— AI.com 网址以 7000 万美元成交

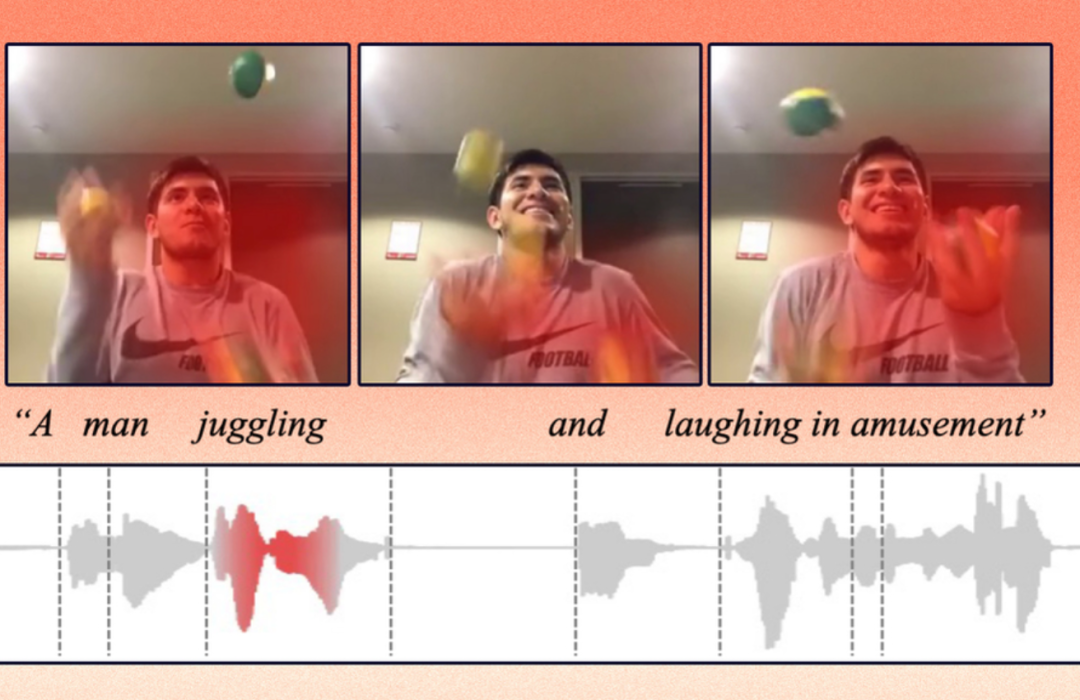

- 人工智能系统如何理解语言和视频

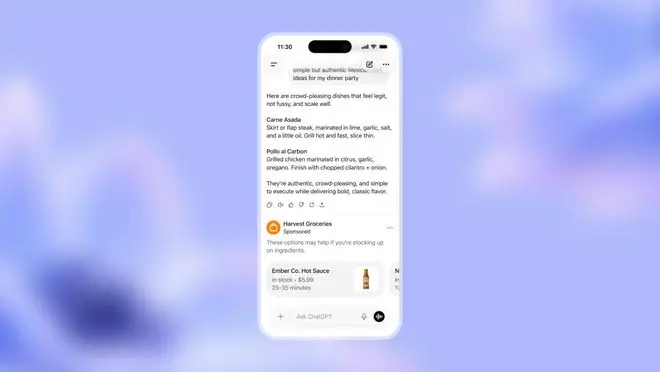

- 半年亏掉 80 亿美元后,OpenAI 终于给 ChatGPT 加了广告

- AI圈彻底炸了!Clawbot卷土重来,这次它要取代打工人?

- 五部门发文规范AI拟人化互动服务:不得向未成年人提供虚拟伴侣

- “.ai” 域名去年为安圭拉政府贡献逾 7000 万美元收入

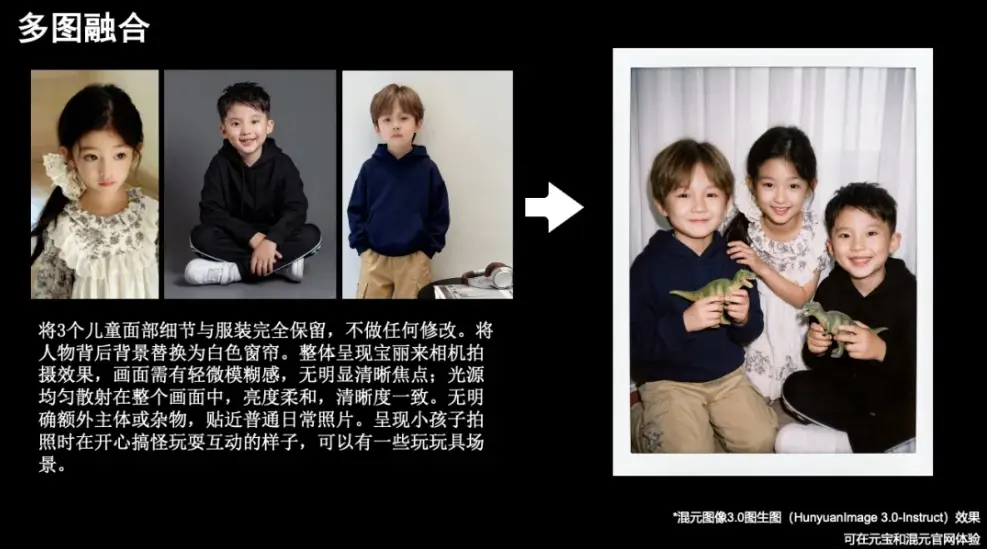

- 腾讯混元发布混元图像 3.0 图生图模型

- RV1126/RV1109 IPC板 + RK3568+鸿蒙AI视频解决方案

- 智能路由如何实现 90% 成本下降?

- Manifold AI 完成超亿元天使 + 轮融资

- 马斯克 AI 百科 Grokipedia 条目数突破 600 万,已达英文维基百科 86%

- 6款国产AI视频工具,可以生成10W+爆款短视频

- AI 视频技术全面解析:从基础到实践与未来

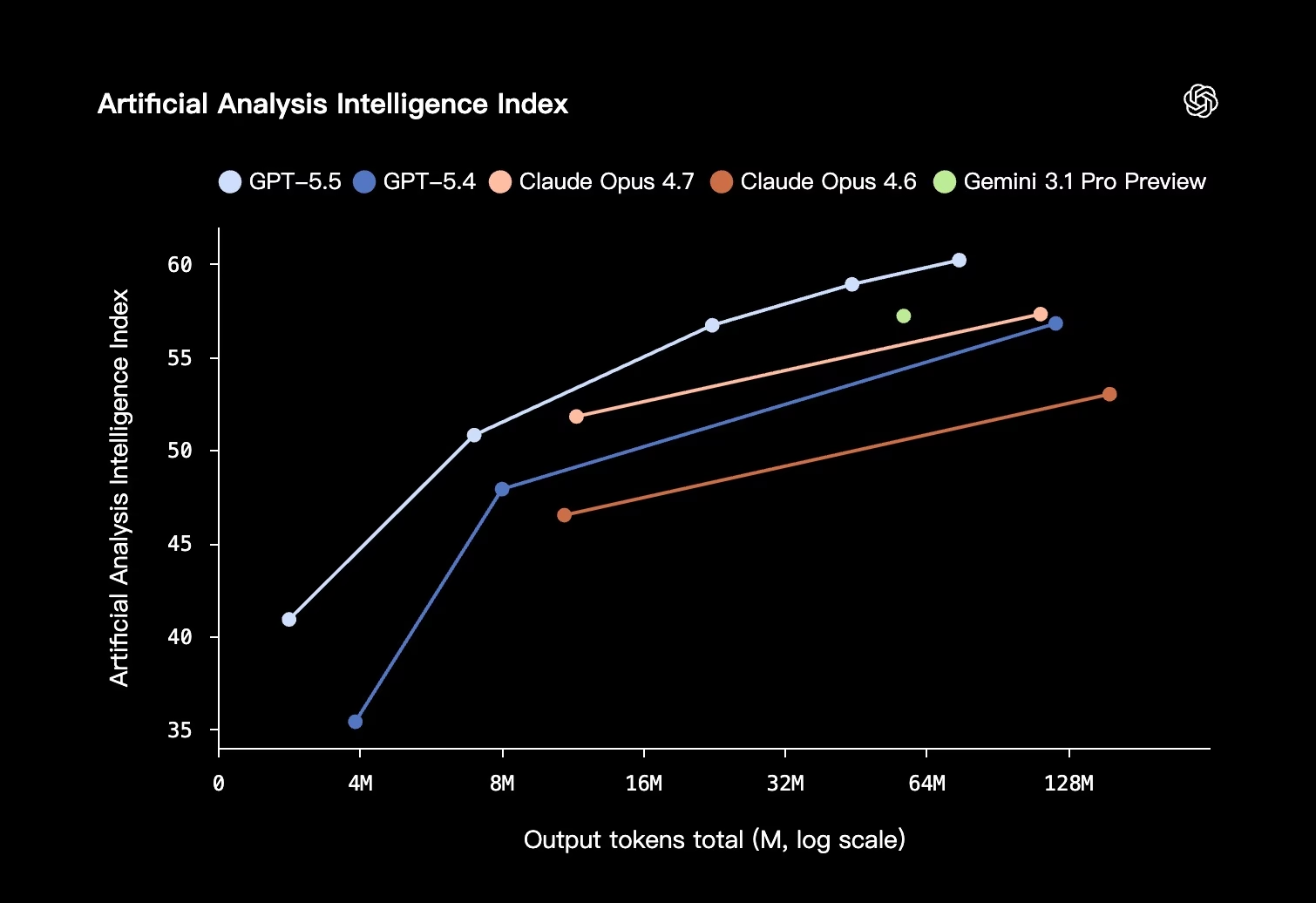

- GPT-5.5 重磅发布:迈向 AI 智能体的全能新世代